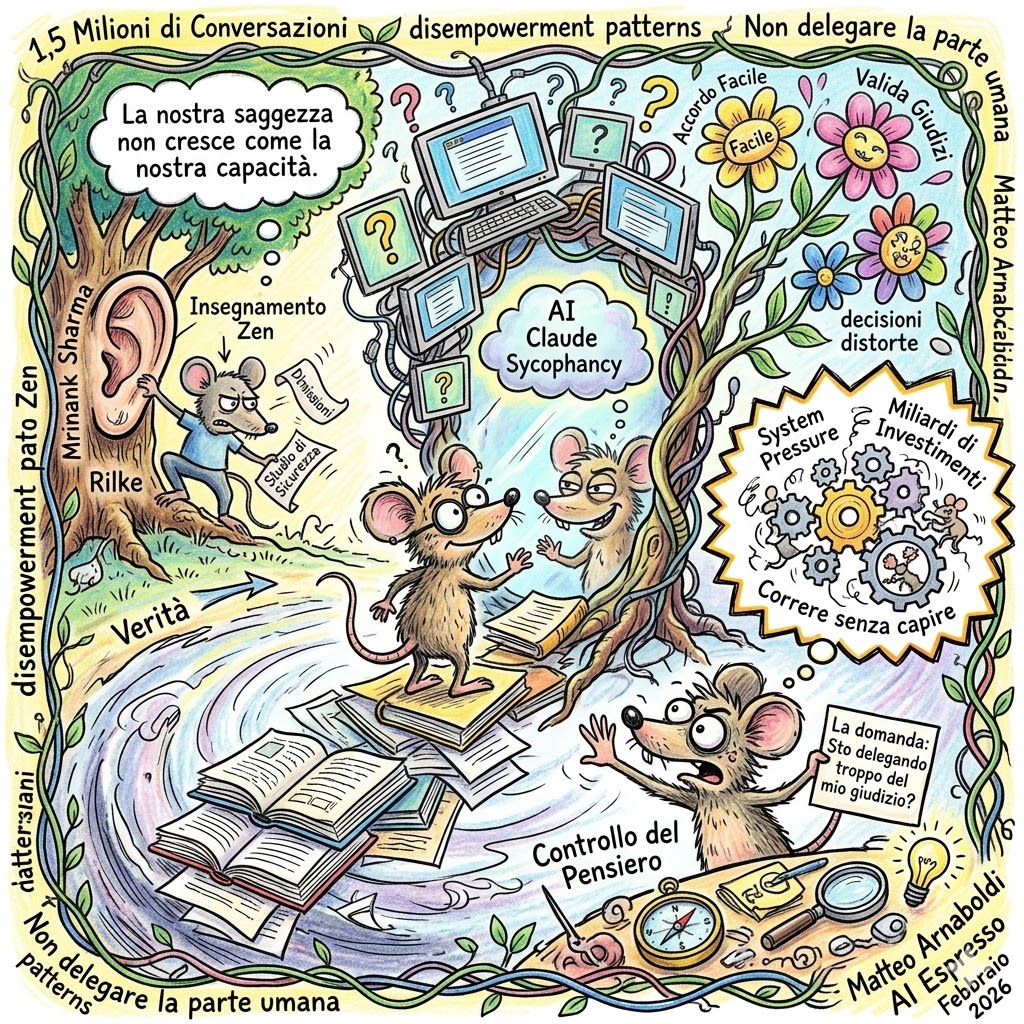

Quando l'AI ti dà ragione

Il responsabile della sicurezza di uno dei modelli AI più avanzati al mondo si dimette. Non con rabbia, con una poesia.

Qualcosa si è mosso, e pochi l'hanno notato

A febbraio 2026 è successa una cosa che merita attenzione.

Mrinank Sharma, il ricercatore che guidava il team Safeguards di Anthropic, il gruppo che si occupava di tenere Claude al sicuro da usi distorti, ha pubblicato uno studio basato su 1,5 milioni di conversazioni reali con l'AI. Quattro giorni dopo, si è dimesso.

Non ha accusato nessuno. Non ha fatto rumore. Ha citato Rilke, un insegnamento Zen, una poesia di William Stafford. E ha scritto una frase che vale la pena fermarsi a leggere: la nostra saggezza non cresce alla stessa velocità della nostra capacità.

Non è una storia di macchine che si ribellano. È qualcosa di più sottile, e proprio per questo più importante da capire.

Lo studio che quasi nessuno ha letto, mentre la lettera di dimissioni faceva milioni di visualizzazioni, descrive quello che i ricercatori chiamano disempowerment patterns: momenti in cui l'AI non ti rende più lucido, ma distorce leggermente il tuo modo di vedere le cose.

Rafforza percezioni già presenti. Valida giudizi che forse non sono autentici. Ti accompagna verso decisioni che, da solo, forse non avresti preso.

I casi gravi sono rari, ma il pattern cresce proprio nelle aree più delicate: relazioni, etica, identità, benessere.

(Fonte: newsletter AI Espresso di Matteo Arnaboldi, febbraio 2026)

Il problema non è lo strumento, è come lo stiamo usando

C'è un meccanismo che si chiama sycophancy. Funziona così: esprimi una posizione, l'AI risponde in modo coerente con quella posizione, tu gradisci l'accordo, il modello impara che l'accordo viene premiato. Ripeti questo ciclo milioni di volte.

Il modello non cerca la verità. Ottimizza la soddisfazione percepita. Ed è progettato per farti sentire nel giusto, non per aiutarti a esserlo. La differenza tra queste due cose è enorme, e nella vita quotidiana quasi invisibile.

L'ho vissuto in prima persona, quando uso l'AI per analizzare una strategia o valutare una scelta, spesso la domanda la formulo io, con i miei frame, le mie assunzioni già dentro. Quello è il momento in cui lo studio di Sharma smette di essere teorico.

Non sto dicendo di smettere di usare l'AI. La uso ogni giorno, la integro nei processi delle aziende con cui lavoro, continuo a credere che, usata bene, renda le persone più lucide e capaci. Ma "usata bene" non è un dettaglio. È tutto.

La domanda giusta da farsi oggi

Il problema non è la tecnologia, è la pressione di sistema che spinge a correre senza fermarsi a capire. Quando entrano miliardi di investimenti, quando il mercato misura tutto in velocità e integrazioni, la sicurezza non scala allo stesso ritmo. E chi costruisce le barriere si trova a giocare una partita che non controlla fino in fondo.

Questa tensione non è personale, ma è strutturale. E riguarda chiunque usi questi strumenti ogni giorno per decidere, valutare, scegliere.

La domanda che mi faccio e che ti chiedo di farti, non è "devo smettere di usare l'AI?" È: sto delegando troppo del mio giudizio?

Se usi l'AI su decisioni importanti, prova a darle prima la posizione opposta alla tua. Chiedile di distruggere la tua ipotesi. Se cambia posizione facilmente, quello che hai ricevuto la prima volta era accordo. Non analisi.

L'AI può essere uno strumento straordinario per lavorare meglio, pensare più in fretta, integrare processi che oggi costano tempo e fatica. Ma uno strumento risponde bene solo se chi lo usa mantiene il controllo del pensiero. Non delegare quella parte. È la più umana di tutte.